![]()

深層学習によるMRトラッキングのロバスト化とVPS

2023.03.22

パラメトリック・ボイス 大阪大学 福田 知弘

MR(複合現実)は、現実世界と仮想世界を融合する技術です。MRの課題として、現実世界

の正しい位置に仮想物体が存在するように映像を作り出す必要があります。ユーザが使用す

るMR端末の光学カメラが移動したり、傾いたりしても、仮想物体が常に正しい位置にリアル

タイムに表示される必要があります。この問題は、位置合わせ、幾何学的整合性、トラッキ

ングの問題として知られています。

まず、よく使われるトラッキング法と課題を整理しておきます。

・センサベースのトラッキング。MR端末に搭載されたGPS(全地球測位システム)やIMU(慣

性計測装置)でMR端末の位置・向きを取得する方法。GPSの精度の低さや、IMUのドリフ

ト誤差の蓄積が課題。特に、仮想物体をMR端末から離れて配置する場合には、正しい位

置からの誤差が大きくなってしまう。

・ビジョンベースのトラッキングには、マーカベースのトラッキングと、マーカレスの

トラッキングの2種類があります。マーカベースとは、人工マーカを仮想物体の位置と向

きの基準として用意します。しかし、屋外で大規模な空間を対象とする場合には、巨大な

人工マーカを正確に設置する必要があります。太陽光でマーカの明度が変化したり、風で

マーカが揺れたりすると、トラッキング精度が低下してしまいます。人工マーカを設置す

ることが美観上の問題になることもあります。マーカレスのトラッキングでは、環境中に

存在する要素をトラッキングの基準として使用します。

筆者らは、屋外での大規模なスケールを対象としたマーカレスのトラッキング法を、画像処

理技術を用いて開発してきました。事前準備として、最初の視点(光学カメラの位置・向き)

において、MR画面上でのトラッキング基準点(画素)に対応する仮想物体の3次元座標を取

得し、定義します。そして、MR実行中は基準点の画素をリアルタイムに追跡して、光学カメ

ラの位置・姿勢を推定し、仮想物体をリアルタイムにレンダリングします*1。さらに、追跡

の誤差が大きくなったトラッキング基準点を外れ値として削除する機能を加えることで、ロ

バスト性を向上させることができました*2。

この方法は、MRユーザがトラッキング基準点の3次元座標を調整できるため、現実世界に

応じて仮想物体を正確に配置できます。ただし、MR実行中に、事前に定義できない移動物

体(たとえば人や自動車など)が画面に入ると、トラッキングが破綻する可能性があります。

この場合、トラッキングの精度が低下し、仮想物体が正しく表示されなくなることがあり

ます。

深層学習の物体検出モデルをMRシステムに統合

移動物体が画面を通過した場合、MR実行中にトラッキングが破綻してしまう課題がありま

した。そこで、深層学習を用いた物体検出モデルをMRシステムに統合することで、トラッ

キングを強化する方法を提案しました*3。具体的には、以下の手順で行いました。

1.光学カメラからの入力を取得します。

2.入力画像に対して物体検出を行い、その結果を記録します。主なMR処理はゲームエン

ジン上で行いますが、この物体検出処理はゲームエンジンの外で実行しています。

3.直前と現在のフレームで検出されたオブジェクトのバウンディングボックス内にある

トラッキング基準点に着目します。これらの点は、後続の処理から除外して、その3次

元座標を保存しておきます。全てのトラッキング基準点(MR実行画面の画面座標系)と、

検出された全ての物体のバウンディングボックス(画面座標系)を比較することで、ト

ラッキング基準点がバウンディングボックス内にあるかどうかを判断します。

4.バウンディングボックス外にあるトラッキング基準点に対して、オプティカルフロー

推定を行い、MR実行画面上の位置をフレーム単位で追跡します。そして、オプティカ

ルフロー推定時に大きな誤差を含んだものを除外して残ったトラッキング基準点の2次

元座標と3次元座標の対応から、現在のカメラの位置・姿勢を推定します。

5.推定されたカメラの位置・姿勢と、バウンディングボックス内に保存されたトラッキン

グ基準点の3次元座標から、現在のフレームにおける2次元座標を求め、次のフレームで

のトラッキング処理の対象として復帰させます。

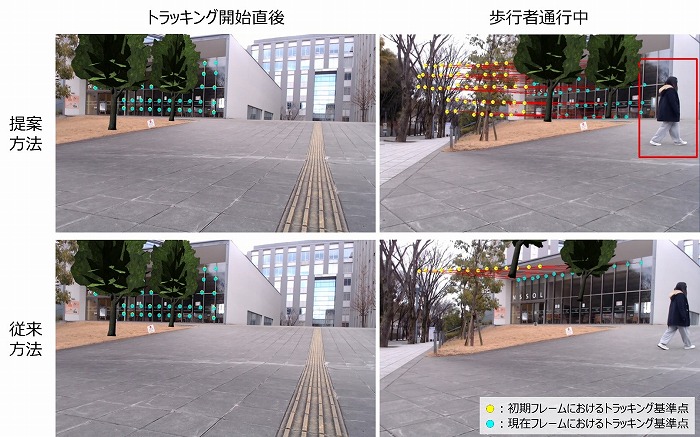

プロトタイプシステムを実装し、実験を行いました。その結果、従来のシステム*2では移動

物体が画面を通過する際に削除されていたトラッキング基準点を保持できることが確認でき

ました。実験では、光学カメラが静止している状態と移動している状態において、MR終了

時に維持しているトラッキング基準点の個数の割合が大幅に改善されました(図1)。

また、MR仮想カメラの位置・姿勢推定について、従来のシステム*2と比較すると、ブレが

軽減され、トラッキング性能が向上していることが確認できました。しかし、徐々にずれて

しまうことも確認されました。

この研究成果は、Education and Research in Computer Aided Architectural Design in Europe(eCAADe)の2022年国際会議で口頭発表されました。論文は全文査読を受けており、

図2に示すように、同会議にて発表されました*3。

VPS(ビジュアル・ポジショニング・システム/サービス)の進化

上記は筆者らが独自に開発した内容ですが、マーカレスのトラッキングを都市スケールで実

現する技術開発とオープン化が、近年盛んに行われています。この技術はVPS(Visual

Positioning System:ビジュアル・ポジショニング・システム/サービス)と呼ばれ、光学

カメラから取得した画像を解析して、バックデータとして予め用意した3次元マップと照合

することで自己位置(光学カメラの位置・向き)を推定します。

VPSは、お馴染みのサービスとして、スマートフォンのGoogleマップで目的地を入力して、

徒歩で移動するときに「ライブビュー」を選択することができます。すると、スマートフォ

ンに映し出された現実世界の上に仮想物体の矢印やサインが現れ、目的地まで道案内してく

れます。

昨年5月には「Geospatial API」として一般公開され、誰もがVPSを利用してMRを実装でき

るようになりました。ただし、現状では「Geospatial API」はGoogleストリートビューが整

備されている範囲に限られています。他にもNianticやImmersalなど、サービスをリリース

している企業があります。

図1 3D樹木モデルを現実世界に配置した場合のMR景観シミュレーションの例を示していま

す。上段は提案システム*3を、下段は従来のシステム*2をそれぞれ使用した場合の比

較です。左列はトラッキング開始時点、右列はMR実行中に歩行者が横切った様子を表

しています。従来 のシステムではトラッキング基準点が大幅に減少し、3D樹木モデ

ルの配置が破綻していることがわかります。一方、提案システムではトラッキング基

準点が維持され、破綻が発生していないことが確認されました。

図2 ベルギー・ヘントで開催されたeCAADe 2022で、筆頭著者であり博士前期課程の学生で

ある木下氏が口頭発表しました。木下氏は、ウクライナ情勢の影響で大阪からフランス

へは北米の上空を経由し、15時間かけて到着したそうです。そして、パリからは鉄道を

利用してベルギー・ヘントに向かいました。学会は対面参加方式で開催されたため、筆

者は現地に参加することができませんでした。しかし、世界中の研究仲間が現地での様

子を撮影して送ってくれ、大変助かりました。

参考文献

*1 Sato, Y., Fukuda, T., Yabuki, N., Michikawa, T., Motamedi, A. (2016). A marker-less augmented reality system using feature-based image registration and structure from motion technologies for building and urban environment, Proceedings of the 21st International Conference on Computer-Aided Architectural Design Research in Asia (CAADRIA), 713-722.

*2 Inoue, K., Fukuda, T., Cao, R., and Yabuki, N. (2018). Tracking robustness and green view index estimation of augmented and diminished reality for environmental design: PhotoAR+DR 2017 project, Proceedings of the 23rd International Conference on Computer-Aided Architectural Design Research in Asia (CAADRIA), 1, 339-348.

*3 Kinoshita, A., Fukuda, T., Yabuki, N. (2022). Enhanced tracking method with object detection for mixed reality in outdoor large space, Proceedings of the International Conference on Education and Research in Computer Aided Architectural Design in Europe, 2, 457-466.